Control de robots y sistemas multi-robot basado en visión

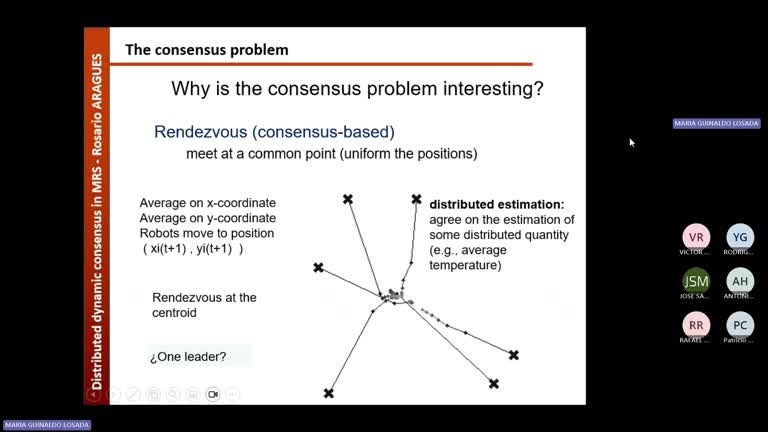

El uso de la visión por computador está muy extendido en muchos ámbitos de nuestra vida, sociales, científicos o técnicos. De una imagen se puede obtener gran cantidad de información, aunque al mismo tiempo la obtención de información de interés y su interpretación siguen presentando un desafío en el que hay muchos aspectos a considerar. La aparición de cámaras omnidireccionales ha abierto todavía más el problema y son muchos los investigadores que dedican esfuerzo para sacar partido del sensor visual. En esta presentación se pretende poner de manifiesto la utilidad de este sensor en el control de sistemas autónomos tipo robot. Los humanos tenemos dos ojos, dos imágenes, y eso nos permite realizar tareas de percepción, reconocimiento, interpretación, etc, para después movernos de forma controlada y con precisión por entornos cambiantes y con obstáculos. Sin embargo, hacerlo así en sistemas robóticos es todavía una quimera. Se hará un repaso a los fundamentos geométricos de la visión que permiten extraer relaciones matemáticas entre las imágenes. Las relaciones geométricas estudiadas son la geometría epipolar, la homografía y el tensor trifocal. Estas pueden servir para obtener mejores y más robustas correspondencias, en una primera fase, y para el control. El control, que como es sabido es una palabra de amplio espectro, se va a abordar aquí desde dos vertientes. Por una parte se pretende que el robot pueda alcanzar el objetivo, su posición final, en base a información visual y por otro se pretende que un conjunto de robots, multi-robot, actúe como un equipo para moverse de forma coordinada o alcanzar una determinada formación final.

-

Carlos Sagües catedrático de universidad, Universidad de Zaragoza